Canciones apócrifas, actuaciones falseadas: los artistas del mundo, en pie de guerra contra la inteligencia artificial

Músicos muertos que sacan nuevas canciones, músicos vivos que cantan clásicos sin saberlo, actores que escuchan su voz exclamando cosas que nunca dijeron...

La inteligencia artificial (IA) está provocando una verdadera revuelta en la industria del entretenimiento. Lo que durante los últimos 20 años por lo menos alimentó las fantasías más conscientes del cine (sobre todo) y la literatura de ciencia ficción dejó de ser pura ilusión para transformarse en el tangible augurio de una inquietante realidad cada vez más cercana y visible.

La IA hace tiempo que dejó de formar parte de las especulaciones sobre el futuro de la humanidad. Ya forma parte del presente. Y el cine, la música, la creación literaria y muchas otras facetas de todo lo que entendemos como entretenimiento, espectáculo y cultura están experimentando transformaciones poderosas, cuyo impacto real es imposible de calcular.

Eso es lo que repiten de manera unánime observadores, analistas y un número cada vez más grande de artífices de la propia industria del entretenimiento. Nadie se pregunta hoy si efectivamente la IA puede llegar a cambiar para siempre a las películas, las canciones y los textos con los que hoy nos relacionamos. La forma correcta de plantear ese interrogante es cuánto tiempo falta para que esos productos reemplacen a los originales. “Cada vez menos”, dicen a coro los expertos. Y en medio de un escenario potencialmente conflictivo.

¿Qué puede hacer la IA en este vasto terreno? Muchísimo. Casi todo, dirían algunos temerarios. La lista incluye todo tipo de herramientas al servicio de la producción, la programación, la creación, la distribución y la localización de todo tipo de actividades, hechos, estrategias y contenidos. Desde acelerar los procesos creativos hasta adaptarlos a las necesidades del potencial consumidor, desde la construcción virtual de personas reales hasta la imitación perfecta de sus voces, gestos, fisonomías, posturas.

En una postura extrema y arriesgada, la IA podría tomar decisiones a partir de su propia inspiración, adoptando una postura autónoma y autosuficiente como la que James Cameron expuso desde 1984 en Terminator . En esta fantasía distópica, la IA se convierte en un poder despótico que controla el mundo a voluntad.

Del otro lado aparece la posición más virtuosa, dentro de la cual la IA es una herramienta que aporta mejoras en el funcionamiento de la industria del entretenimiento aportando nuevas posibilidades de empleo y aumentando al máximo la eficiencia de los procesos creativos . “El temor frente a los peligros de la IA probablemente hable más de la ansiedad generada por la aparición de una nueva tecnología que de la probabilidad real de que esa misma tecnología se vuelva contra nosotros”, señaló el catedrático de Historia de la Universidad de Georgia Stephen Mihm al diario The Washington Post.

Putin, una película satírica sobre el presidente ruso, cuyo rostro se incorporó con tecnología deepfake al cuerpo de un actor, es el primer resultado concreto de este ejercicio que hace tiempo dejó de ser una simple especulación. Todo parece posible a partir de esta certeza. También las inevitables consecuencias laborales, legales, económicas, organizativas y sociales de la entrada de la IA en el cine, la música y la creación literaria o audiovisual. Sin ir más lejos, Hollywood quedó paralizada por completo en 2023 a raíz de una huelga planteada entre otras cosas por el temor frente al arribo de la IA y a sus efectos deletéreos en esa industria.

La IA también estaría en condiciones de eliminar para siempre muchos más empleos de los que podría crear, así como fijar nuevos parámetros para la división del trabajo vigente. Y hasta sería capaz, en las predicciones más alarmantes, de adquirir conciencia propia hasta el punto de estar lista para funcionar por sí sola y asumir todas las funciones que hoy están en manos de seres humanos formados y especializados en múltiples disciplinas. Una nueva sociedad podría configurarse a partir de estos cambios, que nadie se anima a anticipar en cuanto a magnitudes y alcances, pero ya están entre nosotros. Llegaron para quedarse.

El impacto de la IA en el cine

Es bastante probable que el 20 de mayo pasado se haya escrito en el Festival de Cannes la primera página de un diario sobre el futuro del cine. Un porvenir bastante inquietante si tomamos en cuenta todo lo que está en juego. Ese día, un director polaco llamado Patryk Vega, no muy conocido más allá de su país, donde se ven mucho sus películas de acción con tramas elementales y personajes de escaso vuelo, anunció que su nuevo largometraje iba a estrenarse en 35 países (incluyendo los Estados Unidos y la India) a fines de septiembre. La estrella de esta nueva obra, que lleva como título el apellido de su protagonista, es una figura clave de la geopolítica internacional incorporada a la trama por medio de la inteligencia artificial. Putin muestra al líder ruso apenas vestido con un pañal sucio o humillando a su esposa.

Vega desarrolló un modelo deepfake creado por inteligencia artificial (IA) que le permite colocar el rostro verdadero de Putin en el cuerpo de un actor de contextura parecida y lograr así “un efecto realista en la resolución más alta posible”. ¿Estamos ante un caso aislado o frente a la avanzada de una nueva cosmovisión tecnológica, lista para ser usada a gran escala en la producción global de cine y series, primero en Hollywood y luego en el resto del mundo?

Aunque casi nadie parece dispuesto a admitirlo, la segunda opción parece la más plausible. De hecho, como señala un experimentado especialista en efetos digitales del cine más fuerte de Hollywood, David Stripinis, muchísima gente en Hollywood está usando la IA. “Pero no pueden admitirlo públicamente porque todavía necesitas artistas para otras labores y se volverían en tu contra”, dice en una nota del diario español El País. Y agrega que en este momento el tema de la IA en Hollywood tiene más que ver con las relaciones públicas que con la tecnología.

Nadie querría en este momento volver a 2023 y a un escenario de conflicto que paralizó por completo la actividad del enclave más poderoso de la industria del entretenimiento global. Buena parte de esa parálisis tuvo que ver con el reclamo de los sindicatos de guionistas y actores a los estudios de Hollywood para evitar que los estudios alienten la elaboración con herramientas de IA de guiones y de imágenes con los rostros y las voces de artistas reconocidos.

El acuerdo que puso fin a la huelga estableció que ni los estudios ni las productoras podrán recurrir a la IA para incluir en películas o series imágenes de un determinado intérprete sin el consentimiento expreso y previo por parte de esa persona . Y en el caso de los guionistas se acordó que el material armado con inteligencia artificial no se considerará “literario” a todos los efectos concretos.

Pero el riesgo sigue latente y la aplicación potencial de la IA a todo contenido audiovisual parece inevitable. Uno de los directores estrella de la poderosa industria de cine de Bollywood, en la India, profetizó un futuro “caótico” porque tarde o temprano se aplicarán herramientas creativas generadas por IA a la producción de películas y series. “Pueden hacer en segundos lo que a un grupo de guionistas le tomaría semanas enteras”, advirtió.

Inquietantes perspectivas

En el caso de los actores, las perspectivas futuras son igual de inquietantes. Una secuencia completa de dos minutos y medio se filmó íntegramente con IA en una producción india, una película de acción titulada Weapon. Allí se muestra la versión más joven de uno de los actores protagónicos. “Era una alternativa más barata que la acción real”, dijo su director, Guhan Senniappan.

¿Cómo reaccionarán actores, guionistas y otros especialistas del trabajo técnico y artístico de las creaciones audiovisuales si este tipo de experimentos empieza a extenderse y a reproducirse masivamente? Un frente potencial de conflicto mucho más abierto, complejo, extendido y cada vez más difícil de solucionar empieza a abrirse ante un futuro lleno de incógnitas. Sobre todo por la complicada situación económica a la que se enfrentan los estudios y las productoras en todo el mundo.

Muchas de las usinas generadoras de contenidos tienen hoy cuantiosas deudas y se ven obligadas a achicar presupuestos, ajustar sus planes de estrenos y reducir empleos. Para ellas, la IA aparece como una herramienta transformadora que a la vez podría paliar algunos de estos efectos incómodos.

Con la IA, como vimos, los estudios ahorran mucho en trabajo creativo porque las herramientas artificiales sustituyen de manera más rápida y eficiente, por ejemplo, a los guionistas. De la nada, y en segundos apenas, la IA podría escribir una historia completa adaptada de la mejor manera a la idiosincrasia y las expectativas de su público potencial, gracias a los algoritmos que analizan los comportamientos, las preferencias y los gustos de las audiencias.

Y no solo eso. Con la IA se pueden automatizar con la máxima eficiencia varios trabajos que toda la vida fueron manuales en la producción de cine y series: la corrección de color, la sincronización y la mezcla de sonido, el diseño gráfico de imágenes y storyboards, las ilustraciones y escenografías digitales, la animación digital, la creación de voces.

Un peligroso tema de costos

Un estudio difundido a fines de enero por una consultora muy leída en Hollywood vaticina la pérdida directa de al menos 62.000 empleos en la industria audiovisual durante los próximos tres años por culpa de la IA. Y señala que en el mismo lapso un total de 204.000 personas podrían sufrir algún tipo de consecuencia a raíz del impacto de estas nuevas tecnologías. Habrá nuevas oportunidades de trabajo, pero serán mucho menores a las que desaparecen.

Mientras los trabajadores de los clásicos oficios del cine buscan la manera de enfrentar este nuevo escenario, que afecta sobre todo a los primeros empleos, los estudios hacen cálculos en el sentido contrario: gracias a las herramientas de la IA el costo de una película promedio podría reducirse en un 10% en los próximos cinco años.

De esta manera, la matriz industrial de Hollywood podría ingresar muy rápido en una nueva etapa de fuertes transformaciones: más eficiencia con menos estudios, menos empleos directos y muy probablemente un escenario más conflictivo.

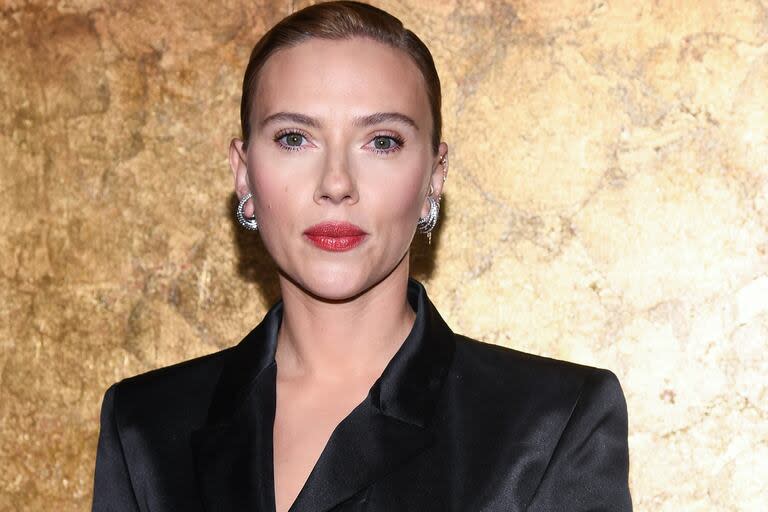

Un ejemplo que adelanta este futuro posible se conoció en los últimos días y tuvo como protagonista a Scarlett Johansson en un papel real que se parece bastante a un personaje que la propia actriz interpretó en una película directamente conectada con la IA. Todo empezó cuando Johansson hizo público su enojo porque el nuevo ChatGPT desarrollado por la empresa OpenIA incluyó en su presentación una voz, a la que llamaron Sky, de extraordinario parecido con la suya.

Todo tiene al parecer su origen en Ella (Her, 2013), recordada y muy elogiada película de Spike Jonze en la que un escritor interpretado por Joaquin Phoenix se enamora de Samantha, la asistente virtual creada por inteligencia artificial de un programa informático que tiene la voz de Johansson.

OpenIA negó de inmediato cualquier parecido entre la voz de Sky (creada por inteligencia artificial) y la voz real de Johansson, pero Sam Altman, director ejecutivo de la compañía, reconoció en su momento que Ella era por lejos su película preferida. Finalmente, OpenIA decidió retirar la polémica voz de la presentación y cambiarla por otra.

Todo se complicó apenas se supo que nueve meses atrás Altman contactó a Johansson para invitarla a que fuera ella la verdadera voz del ChatGPT. La actriz dijo que había rechazado la propuesta en ese momento “por razones personales” y que dos días antes de la presentación Altman volvió a llamarla reiterando el pedido. Volvió a negarse y casi al mismo tiempo se produjo la presentación. Johansson escuchó la voz de Sky, tan similar a la suya, y tomó a esa altura el tema como una ofensa personal.

Dijo estar “sorprendida, enojada e incrédula” al escuchar una voz “inquietantemente similar” a la suya. “Mis amigos más cercanos y los medios no podían notar la diferencia. En una época en la que todos lidiamos con los deepfakes y la protección de nuestra imagen, nuestro trabajo y nuestra identidad, estos temas requieren una claridad absoluta”, dijo la actriz.

También sostuvo que todavía no hay garantías legales suficientes para proteger los derechos de imagen e identidad frente a la llamada IA generativa, la que está en condiciones de hacer trabajos creativos como la generación de voces. Hay fundados temores entre los actores por las funciones del nuevo modelo de ChatGPT, que incluye un asistente de voz en condiciones de interpretar todo tipo de expresiones faciales, localizar emociones y hasta ponerse a cantar.

Las próximas batallas se librarán en el terreno legal. Los reclamos de los actores y guionistas de Hollywood llegaron al Senado estadounidense, dentro del cual se prepara un proyecto de ley que otorga a los actores y sus herederos el uso exclusivo de los derechos de imagen y voz en todo tipo de soporte o dispositivo, incluyendo los digitales y los creados artificialmente, por un período de 70 años. Los legisladores lo llaman “derecho de replicación digital” y solo están exceptuadas las transmisiones informativas, deportivas y documentales con propósitos de divulgación histórica, crítica o satírica.

Del otro lado, el vicepresidente de la poderosa Motion Picture Association of America, la entidad que nuclea a los estudios más grandes de Hollywood, advirtieron que una medida de este tipo podría ser inconstitucional porque iría en contra del principio de libertad de expresión establecido en la Primera Enmienda. Los expertos advierten que la última palabra la tendrá en este caso la Corte Suprema. Mientras tanto, la IA avanza inexorable en su desarrollo. Los tiempos legales son mucho más lentos que los fijados por el avance tecnológico. Las próximas páginas que se escriban sobre el futuro del cine serán también inevitablemente conflictivas.

En la música

“Los muchachos peronistas/todos unidos triunfaremos”, entona Luis Alberto Spinetta con pronunciación afectada sobre una base minimalista de guitarra. No hay duda, no es un tributo, no es un imitador, no es Luis Almirante Brown: es Spinetta. El video toca una fibra sensible, o dos: es uno de los músicos más geniales de la historia del rock argentino, celebrando a un líder popular, y en esta coyuntura de pasiones exacerbadas no es algo que se pueda dejar pasar. La versión no tarda en circular en redes sociales, vía WhatsApp, por todos lados. Y así como corre la música, corren también los comentarios: se habla de “hallazgo”, se discute con fervor sobre la pertenencia política del Flaco (algunos recuerdan su breve militancia en las Juventudes Argentinas para la Emancipación Nacional a fines de los 60, otros contraatacan con su apoyo a Raúl Alfonsín) y alguno arriesga un “che, ¿es real esto?”. Y sí, es real, pero eso no significa que alguna vez Luis Alberto Spinetta haya grabado la Marcha peronista en altísima calidad de audio: lo que escuchamos es, desde ya, una creación de la inteligencia artificial.

O no tanto, porque el video lleva la firma de Martín Cantalupi, el humano responsable de la acción que (todavía) es fundamental en estos menesteres: dar las órdenes. Martín encontró en esta versión de la Marcha peronista el tesoro de la verosimilitud: la voz de Spinetta es la suya, la base está lograda, la canción es contemporánea al Flaco, algún link conceptual entre tema y supuesto intérprete efectivamente existió (de ahí el primer comentario en YouTube: “No puedo creer lo creíble que suena, loco. Me costó muchísimo entender que era una IA y no una grabación inédita”). Todo esto se rompe en la segunda creación de Martín: “Traigan al gorila de Milei”, otro himno justicialista que reivindica “las banderas de Evita y Perón” con la melodía de la cortina de los cortos de Clemente de los años 70. Ahí no hay forma de dudar: los universos de Spinetta y el actual presidente no se cruzan, con lo cual queda expuesto que se trata de un artificio, divertido pero increíble.

Algo parecido pasa con Frank Sinatra y los innumerables fake-covers a su cargo que pueden escucharse en la web. Si bien es raro escucharlo cantar “Basket Case” de Green Day, “Smells Like Teen Spirit” de Nirvana o “Gangsta’s Paradise” de Coolio, técnicamente sería posible: todas esas canciones son anteriores a 1998, año del fallecimiento de La Voz. No así “Flowers”, grabada por Miley Cyrus un cuarto de siglo después de que Frankie pasara a la inmortalidad: las cuentas no dan, pero siempre se puede convencer a alguien de que en realidad la de Miley es una versión y la de Sinatra, la original inédita y poco conocida.

Se discute hasta el cansancio el valor de estas recreaciones pero algo es objetivo: que Frank esté grabando todas estas canciones después de muerto, al menos hizo que los bossa n’ lo-que-sea al fin sirvieran para algo. Mucha gente supone que lo que se escucha en estos temas es una voz y un arreglo digital, cibernético, completamente inventado por un algoritmo; y no, el proceso de creación parte de una base que puede estar extraída de una grabación previa (en el caso de “Flowers”, de la versión de PostModern Jukebox) o tocada a pulso para la ocasión (así se hizo la Marcha peronista del Flaco). Para sintetizar y no caer en complejidades técnicas: lo que oímos como Sinatra no es una computadora sino la voz de un cantante humano a la que se le cambia el timbre, la expresión, el registro y el caudal por unos exactamente iguales a los de Frank. Lo que suena tiene modulaciones, tiene fiatos e incluso tiene errores, por la sencilla razón de que todo eso lo hace una persona a la que después se le “injerta” un estilo ficticio. Así, el Bossa & Marley más olvidable puede, por una vez, servir de base para que el Chairman of the Board nos deleite con una versión verosímil de “No Woman No Cry”.

Un gran ejemplo de creación “desde cero” es el canal There I Ruined It. Fundado por el músico estadounidense Dustin Ballard como una forma de matar el tiempo durante la pandemia de Covid-19 empezó por versionar canciones populares en formas disparatadas (“Shallow”, de la película Nace una estrella en clave de polka; “Break Stuff”, de Limp Bizkit en el estilo de un musical de Broadway) y -con el avance de la tecnología- mutó en un proyecto en el que esas versiones “locas” están a cargo, ya no de él mismo, sino de leyendas de la música. Esto lo logra, justamente, grabando la canción completa con instrumentos orgánicos y MIDI y aplicando a sus partes vocales los patrones de cantantes reconocidos. Así, por ejemplo, Simon & Garfunkel puede hacer “Baby Got Back” de Sir Mix-A-Lot (imperdibles las armonías suaves con la letra “me gustan los culos grandes y no lo puedo negar”) y Johnny Cash nos puede regalar un desconcertante cover de “Barbie Girl” de Aqua.

Otra variante es Obscurest Vinyl, un falso sello de grabación que recopila supuestas canciones grabadas en los 50, 60 y 70 que nunca fueron difundidas. Lo que en realidad sucede es que, a partir de portadas de singles inventadas por el creador del canal, la inteligencia artificial se encarga de crear música y letra a partir de certeros prompts. De esta manera podemos escuchar, por ejemplo, a los Sticky Sweethearts con “I Glued My Balls to my Butthole Again”, título que no traduciremos por discreción pero que relata la repetición de un incidente que involucra pegamento y genitales.

Esto que parece ciencia ficción en realidad es producto de unos pocos clics. Aplicaciones y webs como Suno permiten crear canciones eligiendo estilo, velocidad, tonalidad, voz y todo lo demás, e incluso ingresar letras de nuestra autoría para musicalizar a voluntad. El cielo es el límite, y la prueba está en que con cuatro o cinco órdenes concretas, este artículo tiene su propia cumbia (cuyos versos, escritos cien por ciento por la IA, paradójicamente rezan “decían que los robots quieren tomar control, componiendo melodías sin alma ni razón, pero yo me pregunto, ¿dónde queda el corazón?”).

Las posibilidades creativas son infinitas, pero los dilemas no les van en zaga. Duetos impensables, versiones superadoras e incluso nuevas canciones de artistas fallecidos (hace unos años alguien usó IA para crear “Drowned in the Sun” , un “inédito” de Nirvana en base a canciones anteriores procesadas) tienen su lado oscuro: robarle a alguien su voz y hacerle decir/cantar lo que no quiere, y además sin que vea un mísero dólar.

El pasado 29 de marzo la firma OpenAI, creadora de ChatGPT, reveló que tiene avanzado el desarrollo de una herramienta que puede generar un clon realista de la voz de alguien con solo una grabación de 15 segundos. En el anuncio, la compañía señalaba que es consciente de los riesgos que esto implica y que por ese motivo -entre otros- todavía no liberó el recurso al público. Una semana más tarde, 200 artistas de primer nivel (Nicki Minaj, Katy Perry, Billie Eilish, Stevie Wonder, J Balvin, Jon Bon Jovi, etc.) firmaron una solicitada en contra del “uso predatorio” de la IA en la música: con la legislación en la materia todavía a medio cocinar, cualquiera podría usar alguno de estos clones y hacerlo grabar canciones sin autorización y sin copyright. Como todo en la vida, la inteligencia artificial en la música tiene un lado luminoso y uno oscuro: componer un tema y condimentarlo con una hermosa armonía de Amy Winehouse (de eso precisamente habla el corto BZRP.ai dirigido por Armando Bo, publicado pocos días atrás: de Bizarrap pudiendo hacer música “con Taylor, Justin, Dua… con quien quieras”), o hacer que Freddie Mercury cante una proclama terrorista, confundir a medio mundo y lucrar con ello. ¿Quién tiene el poder de decidir si se usa para el bien o para el mal en base a su ética y su moral? El humano, siempre el humano.

Yahoo Estilo

Yahoo Estilo